News

Data protection-friendly big-data analyses

Using large amounts of data in a privacy-friendly way - ATHENE researchers demonstrate technical possibilities

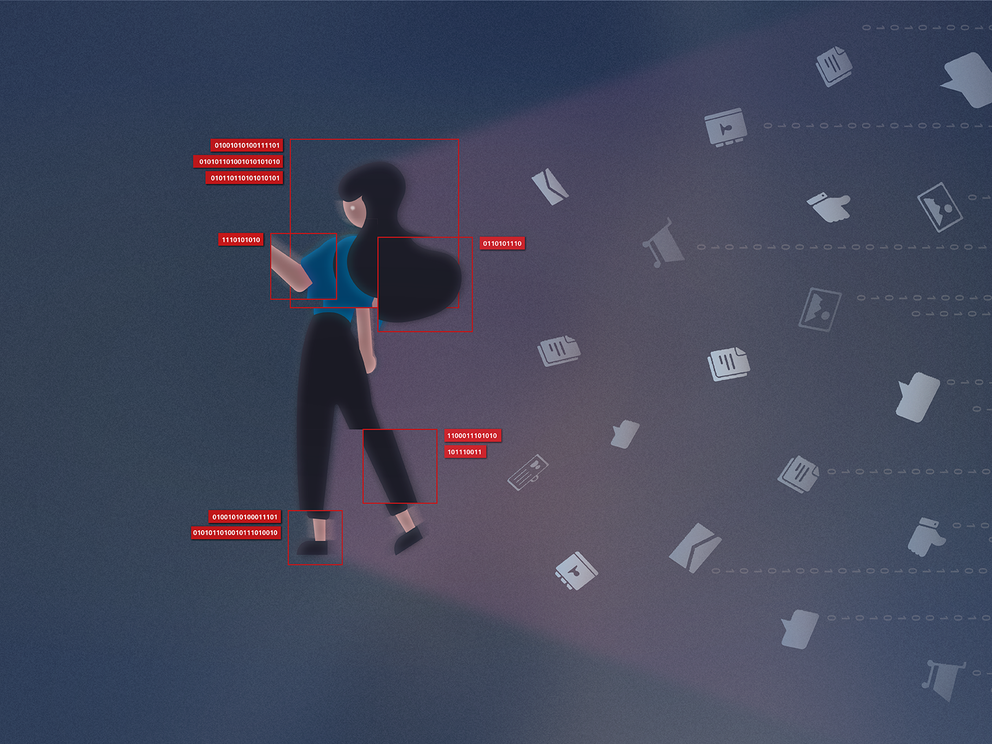

The analysis of large amounts of data enables numerous improvements - in the fight against climate change as well as in medicine. At the same time, today's big-data analysis possibilities create entirely new risks for people's privacy. If data from different sources is combined in the analysis, it is often possible to combine supposedly anonymous data to create personal profiles, with sometimes unforeseeable consequences for the people concerned. A new study by the Fraunhofer Institute for Secure Information Technology SIT therefore shows how big-data technologies can be used without harming the privacy of individuals. The study is aimed at users and developers of big data systems and is available for free download at https://www.sit.fraunhofer.de/reports/

More information in German:

Das Unternehmen New York City Taxi veröffentlichte im März 2014 die Reiseprotokolle von 173 Millionen Taxifahrten, um diesen Datensatz der Forschung zur Verfügung zu stellen. Die Protokolle enthielten Start- und Zielort, Datum und Uhrzeit der Fahrt, Trinkgeld sowie anonymisierte Hinweise auf die Identitäten der Fahrer. New York City Taxi nutzte die Lizenz-Nummern der Fahrer, um daraus einen anonymisierten Wert zu erstellen. Forscher, die mit dem Datensatz arbeiteten, gelang es jedoch, diese Nummern zu de-anonymisieren – indem sie allgemein zugängliches Wissen darüber, wie New Yorker Taxi-Lizenznummern aufgebaut sind, verwendeten. Über die de-anonymisierte Lizenznummer konnten sie herausfinden, wieviel jeder Fahrer an Trinkgeld verdient hatte und ähnliche private Informationen.

Big Data nutzen, ohne Privacy zu schaden

Dies ist nur eines von vielen Beispielen dafür, wie verschiedenste Datenquellen zusammengeführt und durch Big-Data-Analysen auch vermeintlich anonyme Daten de-anonymisiert werden können. „Um solche Privacy-Risiken auszuschließen, müssen Big-Data-Systeme angepasst werden“, erklärt Prof. Martin Steinebach, einer der Autoren der Studie und Leiter der Abteilung IT-Forensik am Fraunhofer SIT. „In unserer Studie haben wir praktisch umsetzbare Lösungsvorschläge für Anwender und Entwicklerinnen von Big-Data-Systemen aufgezeigt und Empfehlungen für den datenschutzkonformen Einsatz der Technologie gegeben, etwa dazu, wie Daten am sinnvollsten anonymisiert werden können.“

Privacy by Design für Big Data

Grundvoraussetzung für die rechtskonforme Verwendung von personenbezogenen Daten in Big-Data-Analysen ist, dass rechtliche Vorgaben eingehalten werden. Die Studie erläutert deshalb zunächst, was genau die Datenschutz-Grundverordnung (DSGVO) und andere datenschutzrechtliche Vorgaben für den Einsatz von Big-Data-Technologien bedeuten. Die Autoren der Studie empfehlen, auf den Grundprinzipien des Privacy by Design aufzubauen, also Datenschutz schon bei der Konzeption und Entwicklung eines Systems mitzudenken. „Die große Herausforderung besteht darin, ein System zu entwickeln, das datenschutzfreundlich und dennoch technisch machbar ist“ resümieren die Autoren. In der Studie erläutern sie, wie das praktisch umsetzbar sein könnte, und zeigen dies anhand von unterschiedlichen Gestaltungsprinzipien, beispielsweise der Analyse von anonymisierten Daten, um an wertvolle Erkenntnisse zu gelangen, ohne personenbezogene Daten zu benötigen.

Verschlüsselung und Anonymisierung für Big-Data-Systeme

Der umfangreichste Teil der Studie gibt einen Überblick über konkrete technische Ansätze, mit denen Daten geschützt werden können. Die Autoren evaluieren die wichtigsten Verschlüsselungstechnologien und empfehlen, welche Ansätze für Big Data am besten geeignet sind. Dabei folgen die Autoren den Verarbeitungsschritten von Daten in Big-Data-Systemen, nämlich sichere Übertragungskanäle („Data in Transit“), sichere Speicherung von Daten („Data at Rest“) sowie sichere Verarbeitung von Daten („Data in Use“). Um Daten durch Big Data gar nicht erst personenbeziehbar zu machen, nennt die Studie verschiedene Verfahren der Anonymisierung für die unterschiedlichsten Arten von Daten, sowohl strukturierte aus Datenbanken als auch unstrukturierte, beispielsweise aus Texten.

Die Studie „Privacy und Big Data“ ist im Verbundprojekt „Cybersicherheit für die digitale Verwaltung“ am Fraunhofer SIT entstanden, im Rahmen des Nationalen Forschungszentrums für Angewandte Cybersicherheit ATHENE. Finanziert wurde die Studie vom Hessischen Ministerium des Inneren und für Sport HMdIS. Sie kann kostenlos hier heruntergeladen werden: https://www.sit.fraunhofer.de/reports/

show all news